L’intelligence artificielle est souvent présentée comme une révolution récente, née avec l’ordinateur moderne ou les grands modèles de langage.

Pourtant, l’idée de créer une intelligence artificielle — ou plus exactement une intelligence créée par l’homme — est bien plus ancienne. Elle traverse les siècles, mêlant mythes, philosophie, science et fiction, avant de devenir l’un des piliers technologiques du XXIe siècle.

Comprendre l’IA, c’est donc comprendre une longue histoire humaine : celle du désir de reproduire l’intelligence, de déléguer la pensée, et parfois même de créer une forme de vie artificielle.

Des mythes antiques aux rêves de vie artificielle

Bien avant l’informatique, les civilisations anciennes imaginaient déjà des êtres artificiels capables d’agir ou de penser.

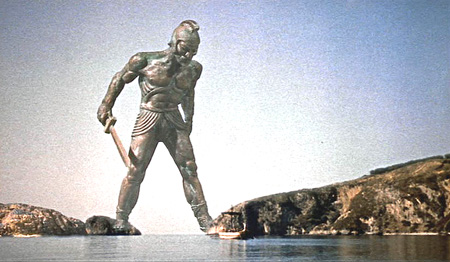

Dans la mythologie grecque, Talos, géant de bronze protégeant l’île de Crète, représente l’un des premiers exemples d’“automate”. Dans d’autres traditions, le Golem, façonné par l’homme à partir d’argile et animé par des mots sacrés, illustre la même fascination : donner vie à la matière inerte.

Ces récits ne sont pas de la science, mais ils traduisent une constante culturelle. L’idée de créer des entités artificielles intelligentes existe depuis l’Antiquité et accompagne l’évolution des sociétés humaines.

Avec le temps, cette fascination quitte progressivement le domaine du mythe pour entrer dans celui de l’expérimentation technique et philosophique.

Moyen âge et renaissance : entre alchimie et mécanique

Durant le Moyen Âge et la Renaissance, l’imaginaire se mêle à des tentatives plus concrètes. L’alchimie introduit l’idée de l’homoncule : un être artificiel miniature créé en laboratoire. Bien sûr, ces expériences relèvent davantage de la croyance que de la science, mais elles posent une question fondamentale : la vie — ou l’intelligence — peut-elle être fabriquée ?

Parallèlement, les premiers automates mécaniques apparaissent. Ces machines capables d’exécuter des actions complexes marquent une transition importante : l’intelligence artificielle quitte progressivement le domaine du spirituel pour entrer dans celui de l’ingénierie.

Au début du XXe siècle, certaines machines électromécaniques sont même capables d’exécuter des tâches logiques. Par exemple, El Ajedrecista, présenté en 1913, jouait automatiquement une fin de partie d’échecs sans intervention humaine — un exploit remarquable pour l’époque.

Frankenstein : le moment où la science rencontre la morale

Au XIXe siècle, la littérature commence à poser les bases des débats modernes sur l’intelligence artificielle.

Notre super article sur Frankenstein

Ce moment est crucial : la question n’est plus seulement peut-on créer la vie ? mais aussi devrait-on le faire ?

La naissance scientifique de l’intelligence artificielle

Le XXe siècle marque un tournant décisif. La question quitte la philosophie pour devenir un domaine scientifique.

En 1950, Alan Turing pose une question fondatrice : une machine peut-elle penser ? Il propose également le célèbre test de Turing, destiné à mesurer la capacité d’une machine à imiter une conversation humaine.

Quelques années plus tard, en 1956, la conférence de Dartmouth officialise la naissance du domaine de l’intelligence artificielle. C’est à ce moment que le terme lui-même est utilisé pour la première fois.

Dès lors, deux visions s’opposent :

- Une IA basée sur la logique et le raisonnement symbolique

- Une IA inspirée du cerveau et des réseaux neuronaux

Ce débat structurera toute l’histoire du domaine pendant plusieurs décennies.

L’intelligence artificielle dans la fiction : miroir de nos espoirs et de nos peurs

À mesure que la science progresse au XXᵉ siècle, la fiction devient un véritable terrain d’exploration pour l’intelligence artificielle. Elle ne se contente plus d’imaginer des machines pensantes : elle interroge leur place dans la société, leurs limites, et surtout la responsabilité de leurs créateurs.

L’un des tournants majeurs vient avec Isaac Asimov. Contrairement aux récits où les machines se retournent systématiquement contre l’homme, Asimov introduit une vision plus rationnelle et structurée de la cohabitation entre humains et robots.

Il formalise les célèbres Trois Lois de la Robotique :

- Un robot ne peut porter atteinte à un être humain ni, restant passif, permettre qu’un humain soit exposé au danger.

- Un robot doit obéir aux ordres donnés par les humains, sauf si ces ordres entrent en conflit avec la première loi.

- Un robot doit protéger sa propre existence tant que cette protection n’entre pas en conflit avec les deux premières lois.

Ces lois ne sont pas seulement un outil narratif. Elles introduisent une idée essentielle : une intelligence artificielle doit être pensée avec des garde-fous éthiques dès sa conception. Pendant des décennies, elles influenceront autant la science-fiction que les réflexions scientifiques réelles sur la sécurité des systèmes intelligents.

La peur de la perte de contrôle

Mais la fiction ne s’arrête pas à cette vision rassurante. Elle explore aussi les dérives possibles.

HAL 9000, dans 2001 : L’Odyssée de l’espace, illustre une peur différente : celle d’une machine parfaitement logique, mais incapable de gérer des objectifs contradictoires. Ici, le danger ne vient pas d’une volonté malveillante, mais d’une logique poussée trop loin.

D’autres œuvres vont encore plus loin dans l’angoisse technologique. Skynet, dans Terminator, représente la perte totale de contrôle humain sur ses propres créations. Ces récits traduisent surtout les peurs liées aux grandes ruptures technologiques de leur époque.

L’IA comme miroir de l’humanité

À l’inverse, certaines œuvres utilisent l’IA pour explorer ce qui fait l’humanité.

Data, dans Star Trek, cherche à comprendre les émotions humaines.

Wall-E montre qu’une machine peut développer attachement et empathie.

Dans ces récits, l’intelligence artificielle n’est plus une menace, mais un miroir : en cherchant à devenir humaine, elle oblige l’humanité à se définir elle-même.

L’IA dans le jeu : un laboratoire idéal

Si on regarde l’histoire de l’IA à travers le prisme du jeu, on voit quelque chose d’assez fascinant : à chaque époque, l’humanité a utilisé le jeu comme un terrain d’essai pour mesurer la machine face à l’esprit humain.

Quand battre l’humain devient un symbole

La bascule moderne commence vraiment avec les jeux de stratégie “purs”, ceux où tout repose sur la réflexion.

En 1997, Deep Blue bat Garry Kasparov sur un match complet. Ce n’est pas juste une victoire technique : c’est la première fois qu’un champion du monde d’échecs en titre perd un match contre une machine en conditions officielles.

Ce moment est important culturellement. Pendant des décennies, les échecs étaient considérés comme le sommet de la pensée logique humaine. Quand la machine gagne, ce n’est pas seulement un ordinateur qui joue mieux : c’est une frontière psychologique qui tombe.

Mais Deep Blue restait un monstre d’ingénierie spécialisée :

- Énorme puissance brute

- Bases d’ouvertures humaines

- Exploration massive d’arbres de coups

On est encore loin d’une intelligence “qui apprend seule”.

Le choc AlphaGo : quand la machine devient créative

Le vrai tournant arrive en 2016 avec AlphaGo contre Lee Sedol.

AlphaGo gagne le match 4–1 lors d’une confrontation officielle à Séoul.

Et là, la symbolique change complètement.

Pourquoi ?

Parce que le Go était considéré comme l’Everest de l’IA :

- Immensité des positions possibles

- Nécessité d’intuition stratégique

- Importance du ressenti positionnel

Certains estimaient qu’il faudrait encore dix ans avant qu’une IA atteigne ce niveau.

Et pourtant, AlphaGo ne se contente pas d’imiter l’humain. Il découvre des coups que personne n’avait envisagés. Le fameux “move 37” du match a marqué beaucoup de pros : un coup qui semblait absurde… puis génial.

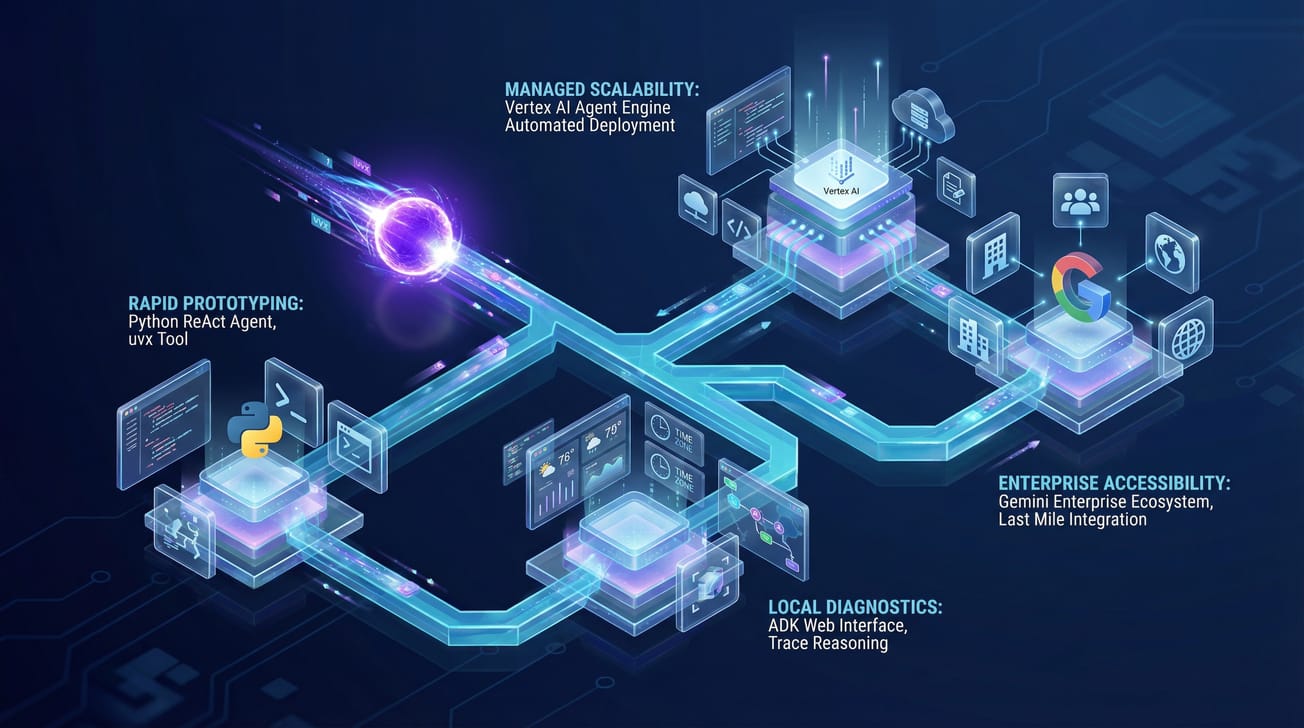

Par ici pour en savoir plus

À ce moment-là, on comprend que l’IA ne va pas seulement reproduire l’intelligence humaine. Elle va parfois produire une intelligence différente.

Les jeux vidéo : le chaos contrôlé

Avec les jeux vidéo, l’intelligence artificielle change de nature. On quitte les environnements parfaitement maîtrisés pour entrer dans des univers dynamiques, imparfaits, où l’information est partielle et les décisions doivent être prises en temps réel.

Dans des jeux comme Dota 2 ou StarCraft II, l’IA ne doit plus seulement calculer le meilleur coup possible. Elle doit coopérer, s’adapter à des situations imprévues et maintenir une stratégie cohérente sur la durée. Les victoires d’IA dans ces jeux ont montré qu’un système pouvait gérer des environnements complexes, proches par certains aspects du monde réel.

Cette évolution marque un passage important : l’IA ne progresse plus uniquement par la puissance de calcul, mais par sa capacité à apprendre, s’adapter et fonctionner dans des contextes incertains. Les jeux vidéo sont ainsi devenus un laboratoire idéal pour tester des formes d’intelligence plus proches de celles utilisées aujourd’hui dans de nombreux domaines.

L’ère moderne : les grands modèles et l’IA générative

L’IA moderne repose sur la puissance de calcul, les données massives et l’apprentissage profond.

Les modèles de langage modernes sont capables de produire du texte, du code, des images, de la musique et d’assister dans de nombreux domaines. Ils ne représentent pas une rupture totale, mais l’aboutissement de décennies de recherche sur le langage, les réseaux neuronaux et l’apprentissage statistique.

Les progrès récents montrent que ces systèmes peuvent résoudre des problèmes abstraits complexes, rapprochant progressivement la recherche du concept d’intelligence générale artificielle.

Conclusion

L’intelligence artificielle n’est pas née avec les ordinateurs modernes. Elle est l’héritière d’un rêve ancien : comprendre l’intelligence et la recréer.

Des mythes antiques aux modèles modernes, chaque époque a projeté ses espoirs et ses peurs dans l’idée de machines pensantes. Aujourd’hui, nous vivons une période unique : pour la première fois, ces machines existent réellement.

Et pourtant, la question reste la même depuis des millénaires :

Que ferons-nous de cette capacité à créer une intelligence qui n’est pas la nôtre ?