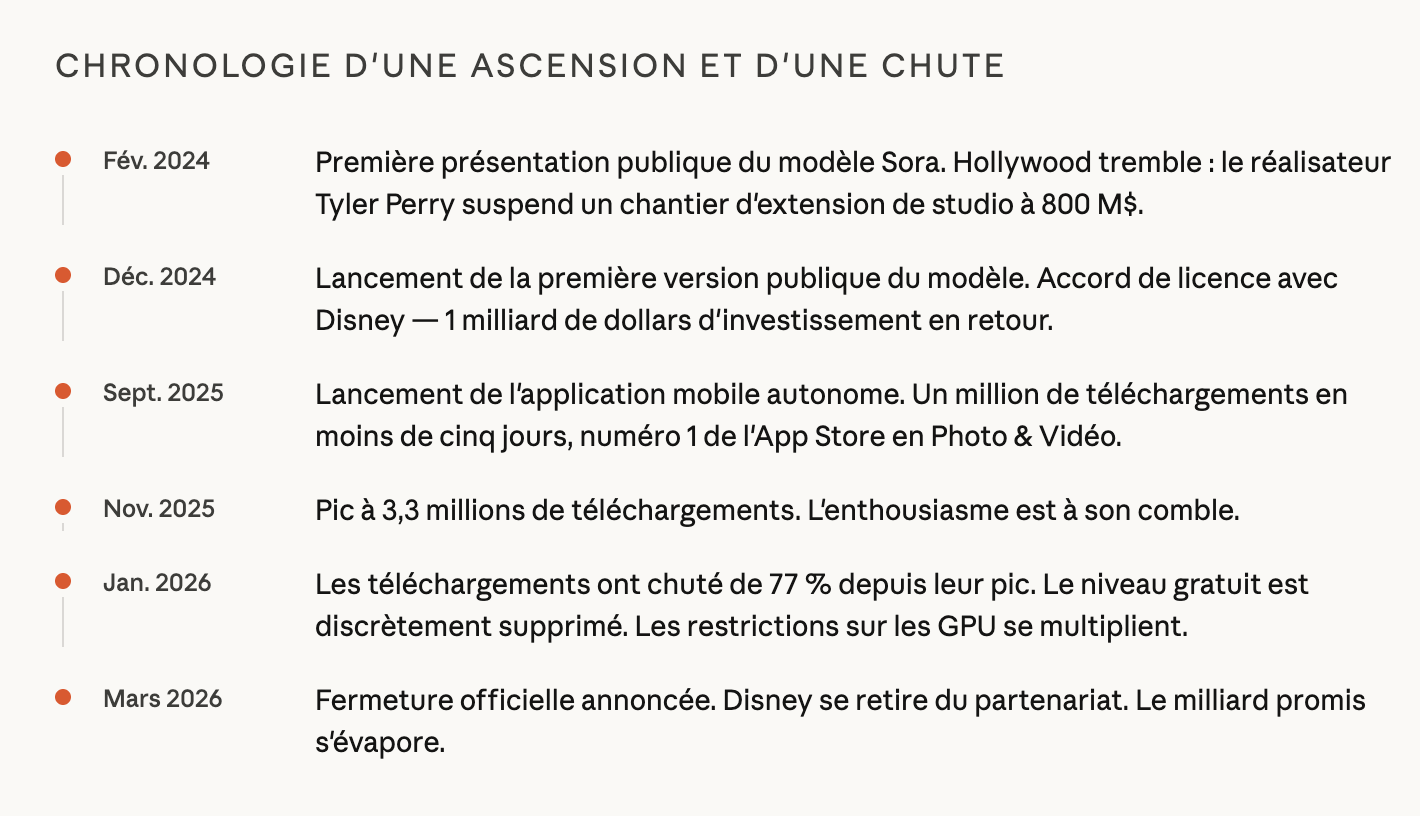

L'arrêt brutal de Sora marque la fin de l'ère du "brute force" computationnel. Entre gouffre énergétique, latence rédhibitoire et la montée de l'IA agentique, retour sur le naufrage industriel d'OpenAI et ce qu'il révèle des limites actuelles des architectures de diffusion vidéo.

Le clap de fin : une équation économique intenable

« Nous disons au revoir à Sora. »

En quelques mots postés sur X le 24 mars 2026, OpenAI a mis un terme à l'une de ses aventures grand public les plus médiatisées. L'application de génération vidéo par intelligence artificielle, lancée en grande pompe en septembre 2025, aura survécu moins de six mois. La fermeture s'accompagne d'une promesse floue sur la conservation des créations des utilisateurs, et d'un silence assourdissant sur les vraies raisons du retrait.

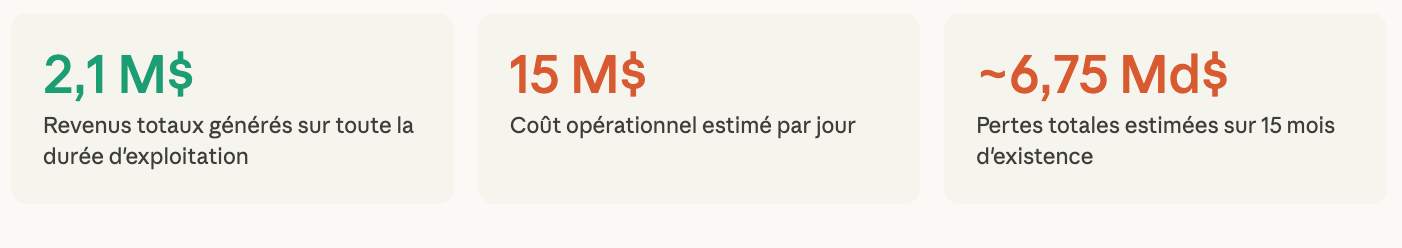

« 2,1 millions de recettes pour 15 millions de coûts par jour : l'équation était intenable dès le premier jour. »

L'échec de Sora n'est pas qu'une déroute comptable ; c'est une impasse architecturale. Si les Scaling Laws ont fonctionné pour le texte, la vidéo haute fidélité a révélé un "mur de verre" technologique.

L'équation énergétique insoutenable

Contrairement à un LLM textuel où le coût marginal d'un token est dérisoire, Sora reposait sur des Spatiotemporal Latent Patches. Chaque seconde de vidéo générée exigeait une densité de calcul VRAM 10 000 fois supérieure à une réponse de ChatGPT. À 15 millions de dollars de coûts opérationnels quotidiens, l'infrastructure n'était pas dimensionnée pour une mise à l'échelle (scaling) rentable.

Le mur de la VRAM : comparatif d'inférence (Texte vs Vidéo) - Pour comprendre l'impasse technique de Sora, il faut visualiser l'écart de ressources nécessaire entre le traitement du langage et la synthèse vidéo temporelle.

| Métrique d'Inférence | LLM Texte (ex: GPT-4o) | LVM Vidéo (ex: Sora) | Ratio Écart |

| Unité de Base | 1 Token (~4 caractères) | 1 Seconde de Vidéo (24 fps) | - |

| Représentation Latente | Vectorielle simple | Spatiotemporal Patches (3D) | ~10 000x |

| Charge VRAM Typique | < 1 Go (avec Quantization 8-bit) | > 80 Go (H100 full cluster) | ~100x |

| Latence de Rendu | < 50ms (Temps réel) | > 1 minute (par seconde générée) | ~1200x |

| Coût Énergétique (est.) | ~0.01 Wh | ~100 Wh | ~10 000x |

Cette infographie illustre le goulot d'étranglement de la VRAM. Alors qu'un LLM peut être optimisé par quantization ou KV caching pour tourner sur des infrastructures modestes, un modèle comme Sora requiert l'équivalent d'un supercalculateur H100 dédié pour chaque requête utilisateur en 4K. C'est cette densité de calcul requise par seconde de vidéo (Spatiotemporal Patches) qui a rendu l'équation économique insoutenable pour OpenAI.

Le goulot de la latence

En production, la latence de rendu empêchait toute itération créative fluide. Là où des acteurs comme Kyutai (Europe) ou Moonshot AI (Chine) explorent des modèles plus légers et modulaires, OpenAI s'est enfermé dans un modèle monolithique trop lourd pour le Cloud public.

Géopolitique de la puissance de calcul

Pendant qu'OpenAI brûlait son capital, l'écosystème mondial a pivoté vers l'efficacité radicale.

- Le pragmatisme asiatique : Des modèles comme ceux de Baichuan ont démontré que l'optimisation des architectures MoE (Mixture of Experts) permettait des résultats visuels comparables avec une empreinte énergétique réduite de 40 %.

- L'alternative européenne : En se concentrant sur la multimodalité native plutôt que sur l'ajout de couches vidéo sur un LLM, des structures comme Mistral ou le laboratoire Kyutai ont ouvert la voie à une IA "frugale" qui rend le ROI industriel enfin tangible pour les entreprises.

Du spectacle à l'utilité : le virage vers l'IA Agentique

La fermeture de Sora s'inscrit dans un recentrage stratégique vers les agents autonomes. Le recrutement de Peter Steinberger confirme qu'OpenAI abandonne les « quêtes secondaires » du divertissement pour la productivité professionnelle.

"Sora était une vitrine technologique extraordinaire, mais un produit industriel médiocre. L'industrie n'a pas besoin d'images parfaites, elle a besoin d'agents fiables."

L'enjeu n'est plus de générer un clip de 60 secondes, mais de créer des modèles capables de contrôler un OS et d'agir. Sur ce terrain, la concurrence est féroce : Anthropic grignote chaque semaine du terrain avec Claude, capable désormais de manipuler un poste de travail de manière autonome.

Le syndrome Hollywood : un répit pour les studios ?

L'ironie est cruelle : Sora avait terrifié les studios. Jeffrey Katzenberg (DreamWorks) prédisait une réduction de 90 % des coûts de production. Quinze mois plus tard, les tournages « à l'ancienne » ont encore de beaux jours devant eux. La complexité de la physique du monde réel reste, pour l'instant, mieux gérée par une caméra que par un GPU en surchauffe.

La chute de Sora marque bien le triomphe de l'incarnation sur la simulation. Comme le soulignait Claude Lelouch, pour qui le cinéma est avant tout une « étude du comportement humain », la machine se heurte à une limite intrinsèque : « l’ordinateur n’a pas de cœur ». Cette absence de "tripes" est précisément ce qui rend la génération synthétique incapable de capturer l'imprévisible de la vie.

En résumé, la chute de Sora agit comme un révélateur brutal : l'écart entre la fascination médiatique et la réalité de la marge brute est devenu un gouffre industriel. À l'approche d'une IPO historique à 1 000 milliards de dollars, OpenAI ne peut plus se permettre de vendre de la « magie » à perte. Wall Street exige désormais de la rentabilité, et non des démonstrations techniques dispendieuses. Et en coupant Sora, OpenAI a "nettoyé" environ 5 milliards de dollars de pertes annuelles prévisionnelles de son bilan.

Ce pivot marque le début d'une nouvelle ère : celle des agents autonomes. Moins spectaculaires mais infiniment plus lucratifs, ces outils de productivité réelle redéfinissent la course à l'IA, transformant le coût de l'inférence en valeur ajoutée immédiate pour les entreprises.