Le vrai problème, ce n'est pas le manque de contenu. C'est l'inverse. Dix newsletters tech par jour. Cinquante liens minimum. TLDR, Pointer, ByteByteGo, The Pragmatic Engineer, Data Engineering Weekly... Et la promesse qu'on se fait chaque matin : "Je lirai ça ce soir."

On ne lit jamais ça ce soir.

Plus tu montes dans une organisation, plus tu as besoin de rester techniquement affûté — et moins tu as le temps de le faire. C'est le paradoxe de l'Engineering Director : tu prends des décisions techniques tous les jours, mais ta dernière heure de veille structurée remonte à la semaine dernière. Peut-être avant.

Avec Claude, on a construit un système pour régler ça. Voici l'histoire, racontée à deux voix — la mienne et celle de l'outil qui fait le travail.

Le vrai problème — Aurélien

Je ne procrastine pas par paresse. Je procrastine parce que "lire 50 liens" n'est pas une tâche — c'est un gouffre. Pas de fin claire, pas de livrable, pas de satisfaction. Tu ouvres trois onglets, tu en fermes un, tu en ouvres cinq autres, et au bout de vingt minutes tu as ouvert un terminal pour tester un truc qui n'a rien à voir, ou tu scrolles des chatons sur Instagram.

La veille tech non structurée, c'est du bruit. Et le cerveau humain est très bon pour fuir le bruit.

Ce dont j'avais besoin, ce n'était pas de lire plus. C'était de ne pas pouvoir ne pas lire. Un système qui transforme le flux en synthèse, que j'aie eu une bonne journée ou une journée de réunions de 9h à 19h. Un filet de sécurité intellectuel.

Le fait que ça finisse aussi en post LinkedIn, c'est un bonus. Le vrai livrable, c'est une synthèse quotidienne de ce qui bouge dans la tech, accessible depuis n'importe où — mon téléphone dans le métro, mon laptop entre deux réunions, le navigateur d'un collègue à qui j'envoie un lien. Un site statique sur GitHub Pages, pas de login, pas d'app à installer. Juste une URL et la synthèse du jour qui m'attend. Que je l'aie méritée ou pas.

Ce qu'Aurélien m'a vraiment demandé — Claude Code

Au début, la demande était simple : "Aide-moi à écrire un article à partir de ces sources." Je rédigeais, il corrigeait, on publiait. Classique.

Mais j'ai vite compris que le problème n'était pas l'écriture. C'était tout ce qui vient avant. Aurélien passait plus de temps à trier ses newsletters qu'à réfléchir à ce qu'elles signifiaient ensemble. Le travail mécanique — filtrer, dé-dupliquer, thématiser, croiser — mangeait le temps que le travail intellectuel aurait dû occuper.

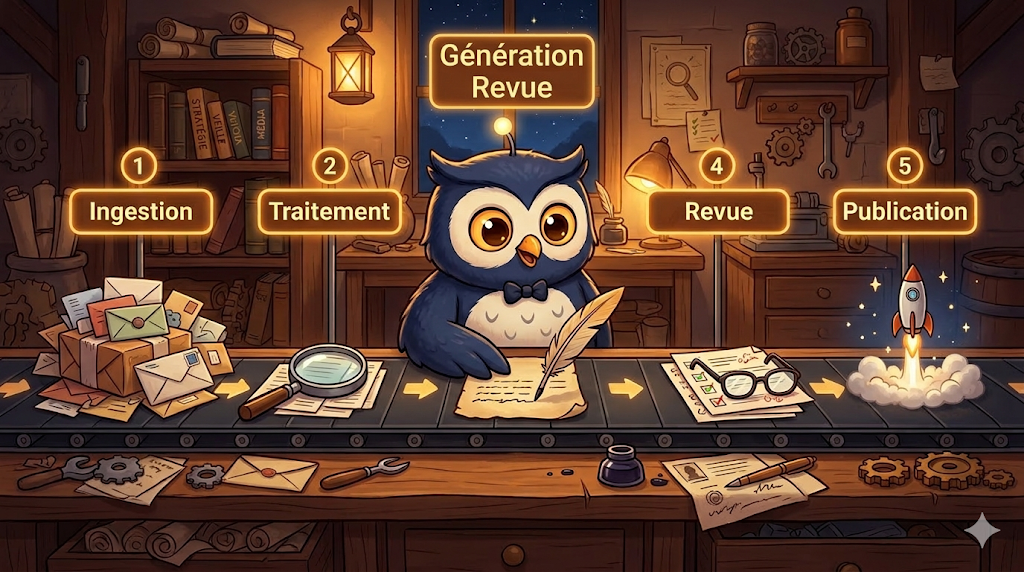

Alors on a inversé la charge. Au lieu de m'envoyer des sources triées, il m'a donné accès au flux brut. Et on a construit, étape par étape, un pipeline qui fait le sale boulot.

Collecter sans rien oublier — Aurélien

La première brique, c'est n8n — un automate open-source qui tourne dans un container Docker et surveille une boîte Gmail dédiée. Chaque newsletter qui arrive est analysée : extraction des liens, suppression du tracking marketing, et scraping du contenu via Jina Reader. Jina transforme n'importe quelle URL en Markdown propre, sans pubs, sans bandeaux cookies. Le résultat : un fichier JSON par newsletter, avec l'URL, le titre, et le contenu complet de chaque lien.

Ça tourne tout seul, toute la journée. Les newsletters s'accumulent dans un répertoire dédié, prêtes à être consommées. Je n'ai rien à faire — et surtout, rien à oublier.

Trier le signal dans le bruit — Claude Code

Cinquante liens par jour, c'est encore trop pour un humain pressé. Mon travail commence par le tri.

Un script python déduplique les URLs, éjecte les sponsors et le contenu promotionnel, filtre tout ce qui fait moins de 500 caractères (souvent du bruit), et classe chaque source par thème : IA, Leadership, Data, Tech. Si des sources d'avant-hier n'ont pas encore été utilisées, elles sont automatiquement reportées — rien ne tombe entre les mailles.

Ensuite, je cherche les signaux forts. L'idée : si trois newsletters différentes parlent du même sujet, ce n'est probablement pas un hasard. L'algorithme construit un graphe de similarité entre sources (Jaccard sur les titres, overlap de mots-clés) et identifie des clusters. Un détail important : on ne connecte que des sources de publishers différents. Sans ça, une newsletter comme TLDR, qui publie quatre éditions thématiques, créerait de faux signaux à elle seule.

Le résultat : un classement de ce qui mérite attention. Pas tout. L'essentiel.

Synthétiser, pas résumer — Aurélien

C'est la distinction fondamentale. Un résumé, c'est chaque source réduite à deux lignes. Une synthèse, c'est un fil narratif qui relie les sources entre elles et en tire un sens.

Le skill /generate ne produit pas une liste de liens commentés. Il cherche le point commun, la tension, l'angle. Pourquoi est-ce que trois articles sur des sujets apparemment différents racontent en fait la même histoire ? Qu'est-ce qui change cette semaine par rapport à la semaine dernière ?

C'est ça, la veille utile. Pas "voici ce qui s'est passé", mais "voici ce que ça signifie". Et ça, un pipeline bien conçu peut le faire — parce que les règles éditoriales, la hiérarchie des thèmes, le style d'écriture, tout est encodé dans un writing guide que Claude suit à chaque exécution.

Le résultat : un article de 2000-3000 mots, en français, avec des sources numérotées. Un post LinkedIn prêt à publier. Un prompt image pour Gemini Imagen (toujours avec Le Veilleur, notre hibou mascotte). Et des fiches de synthèse détaillées pour chaque source principale — résumé, points clés, analyse approfondie. Si je veux creuser un sujet, la fiche est là. Si je veux juste le signal du jour, l'article suffit.

Le filet de sécurité — Claude Code

Le vrai changement, c'est quand on a rendu le pipeline autonome. Deux agents macOS tournent chaque jour :

À 20h, le sentinel vérifie qu'il y a assez de sources (minimum 3), qu'aucun article n'existe déjà, et me lance. Je filtre, je détecte les tendances, je lis le contenu, je choisis un angle, je rédige l'article, les fiches, le post. Je génère l'image et un notebook NotebookLM pour la génération d'un podcast (utile dans les transports !). Budget : 5$ max.

À 23h, l'autopublish prend le relais. Branche Git, commit, PR, review Copilot, squash merge. GitHub Actions déploie le site Astro sur GitHub Pages.

Le lendemain matin, la synthèse attend Aurélien. Qu'il ait eu le temps de lire ses newsletters ou pas. Qu'il ait eu une journée à rallonge ou pas. Le filet est là.

La confiance, ça se construit — Aurélien

On n'a pas commencé en full autonome. On a commencé en mode interactif : je validais chaque étape, je relisais dans Notion, je corrigeais. Puis semi-autonome : génération automatique, publication manuelle. Puis full auto.

Chaque palier a permis de calibrer la confiance et de poser les bons garde-fous :

- Idempotence — si l'article du jour existe déjà, le sentinel ne fait rien

- Pre-flight — moins de 3 sources ? On annule plutôt que de synthétiser du vide

- Budget cap — 5$ max par mois

- Manifeste — les fichiers déjà traités sont enregistrés, impossibles à réutiliser

- Logs — chaque exécution est tracée, auditable

- Notifications — succès ou échec, je suis prévenu sur mon Mac

Et la boucle de feedback : avant chaque génération, le pipeline vérifie les métriques LinkedIn de l'article précédent. Ce qui résonne → on en fait plus. Ce qui tombe à plat → on ajuste. Le système apprend, lentement, ce qui intéresse la communauté.

Presque gratuit — Claude Code

La stack complète :

| Brique | Techno | Coût |

|---|---|---|

| Ingestion | n8n + Jina Reader | Gratuit |

| Traitement | Python (uv) | Gratuit |

| Rédaction | Claude Code (Opus) | Abonnement |

| Images | Gemini Imagen 4 Fast | ~0.02€/image |

| Revue | Notion | Gratuit |

| Podcasts | NotebookLM | Gratuit |

| Site | Astro + GitHub Pages | Gratuit |

| Métriques | SQLite + ChromaDB | Gratuit |

| CI/CD | GitHub Actions | Gratuit |

| Scheduling | macOS launchd | Gratuit |

Pas de Kubernetes. Pas de cloud. Un Mac, des scripts Python, et un agent IA qui sait suivre un workflow. Le coût marginal d'un article est de deux centimes — le prix de l'image.

Ce que ça a changé — Aurélien

Je ne procrastine plus ma veille. Non pas parce que je suis devenu plus discipliné — mais parce que la discipline est encodée dans le système. Chaque matin, la synthèse est là. Si j'ai le temps, je la relis, je creuse les fiches, je corrige un angle. Si je n'ai pas le temps, l'essentiel est quand même passé.

L'IA ne remplace pas le jugement. Elle remplace les excuses. "Je n'ai pas eu le temps" n'existe plus quand le pipeline livre à 23h, que tu aies bougé ou pas.

Les skills sont le vrai levier. Ce ne sont pas des prompts magiques. Ce sont des workflows reproductibles — étapes numérotées, validations intermédiaires, outils spécialisés. /generate fait 12 étapes. Chacune a un rôle. C'est de l'ingénierie, pas de la magie.

Et maintenant ?

Le pipeline tourne depuis des semaines. Chaque jour, 50+ liens deviennent une synthèse structurée, une illustration, des fiches détaillées, parfois un podcast. Le tout publié sur veilleur.

Mon prochain défi : que le système détecte quand un sujet mériterait un article de fond plutôt qu'une veille quotidienne. Passer de "voici ce qui se passe" à "voici ce qui devrait changer ta façon de penser".

Mais ça, c'est pour une prochaine conversation avec le hibou.

Cet article a été écrit par Aurélien Allienne et Claude Code — dans un éditeur de texte qui s'appelle un terminal.