Nous voici à la fin de cette série. J'ai partagé ma vision d'une gouvernance vivante, détaillé un cycle de vie adaptatif et proposé une architecture décisionnelle. Sur le papier, le socle est solide.

Mais je ne suis pas déconnecté des réalités : un socle qui reste théorique ne sert à rien. Et pire, un socle qui coûte des millions sans ROI ou qui aliène les équipes est un échec.

Pour conclure, je veux aborder les sujets qui fâchent souvent : l'argent, la mesure du succès et, surtout, la place de l'humain dans cette nouvelle équation.

1. La réalité économique : scaler selon ses moyens

Soyons honnêtes : toutes les entreprises ne sont pas Google. L'argent est une ressource rare. Mon socle a été pensé pour être scalable. Il ne s'agit pas d'embaucher 50 personnes pour créer un "Studio IA" dès le premier jour.

Je recommande une approche progressive, inspirée de la logique TOGAF (Business > Data > Tech) :

- Horizon 1 (Les Fondations) : On ne dépense pas en infrastructure lourde. On nomme une "Core Team" (même partielle), on ouvre la "Fonderie" (sandbox) et on laisse les pionniers explorer. L'investissement est minime, le focus est sur l'acculturation.

- Horizon 2 (La Structuration) : Une fois que les premiers cas d'usage prouvent leur valeur (et seulement à ce moment-là), on investit. On outille la plateforme, on formalise la matrice de criticité. C'est le business qui finance la tech, pas l'inverse.

- Horizon 3 (L'Optimisation) : On cherche l'efficacité opérationnelle.

C'est ici qu'il faut être vigilant sur le cadre budgétaire des outils qui exploitent l'IA (le Run). Contrairement au logiciel classique, l'IA générative introduit un coût variable perpétuel (coût par token, coût d'inférence). Une fonctionnalité gratuite en démo peut coûter une fortune si elle est déployée à 10 000 utilisateurs sans garde-fous. L'architecture doit donc intégrer une approche FinOps dès le design : a-t-on vraiment besoin de GPT-4 pour cette tâche, ou un petit modèle open-source, moins cher et hébergé chez nous, suffit-il ?

Si la feuille de route ne suit pas l'ambition réelle et les moyens de l'entreprise, on construit une usine à gaz.

2. Sortir du flou : mesurer par la data, pas l'intuition

J'ai trop souvent vu des projets IA validés sur un "effet waouh" ou un ressenti utilisateur vague. C'est dangereux. Dans mon approche, l'UX est centrale, mais elle ne doit pas masquer la réalité technique et économique. Il ne faut pas passer à côté des données concrètes d'utilisation.

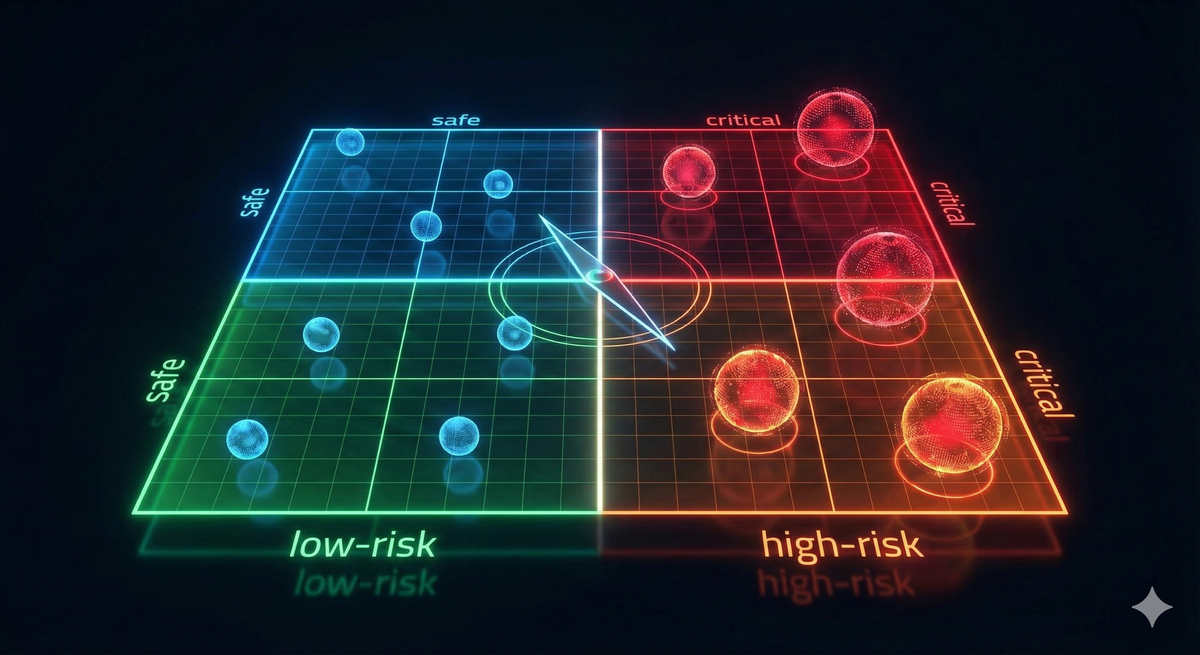

Pour piloter ce système, je suis une règle simple : peu d'indicateurs, mais des indicateurs qui font mal s'ils sont rouges. Je distingue deux catégories :

- Indicateurs d'Innovation (Pour éviter la paralysie) : Je ne mesure pas le nombre de projets réussis, mais le temps de passage entre l'Exploration et l'Incubation. Je surveille aussi le taux d'abandon : si personne n'échoue dans la Fonderie, c'est qu'on ne prend pas assez de risques.

- Indicateurs de Maîtrise (Pour éviter le chaos) : Au-delà de la sécurité, je regarde la dette technique. Un PoC qui reste en production sans passer par la case "Industrialisation" est une alerte majeure.

3. Le défi RSE : responsabilité humaine et environnementale

C'est le point le plus important de ma réflexion. L'intégration massive de l'IA pose un double défi de responsabilité.

D'abord, la responsabilité Sociale. L'IA pose un risque réel : celui de voir les humains réduits à "surveiller" des machines qui vont trop vite pour eux. Aucun de ces deux schémas n'est acceptable ni durable.

Nous devons changer de paradigme. Il ne faut plus chercher à insérer l'IA dans nos processus actuels, mais repenser les processus autour d'un binôme Humain-IA.

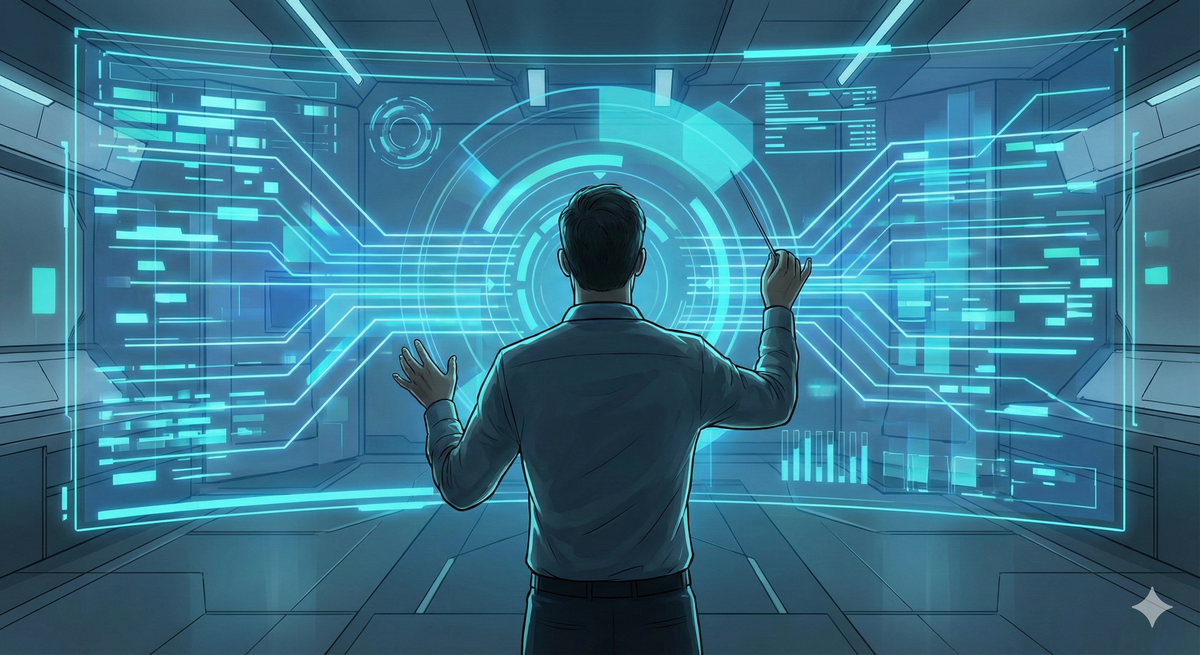

Prenons un exemple concret avec les développeurs. S'il utilise l'IA juste pour coder plus vite, on gagne un peu de productivité. Mais si on change le paradigme, ce développeur ne doit plus "juste" coder. Grâce à l'IA, il peut désormais gérer l'infrastructure, la CI/CD, les tests et la sécurité. Il devient un orchestrateur.

L'IA ne doit pas servir à faire la même chose avec moins de gens, mais à permettre aux mêmes gens de faire des choses beaucoup plus vastes. Cela demande une refonte de nos méthodes d'onboarding et de formation. Nous devons créer des processus d'apprentissage accéléré pour que nos collaborateurs puissent embrasser cette complexité nouvelle sans s'épuiser.

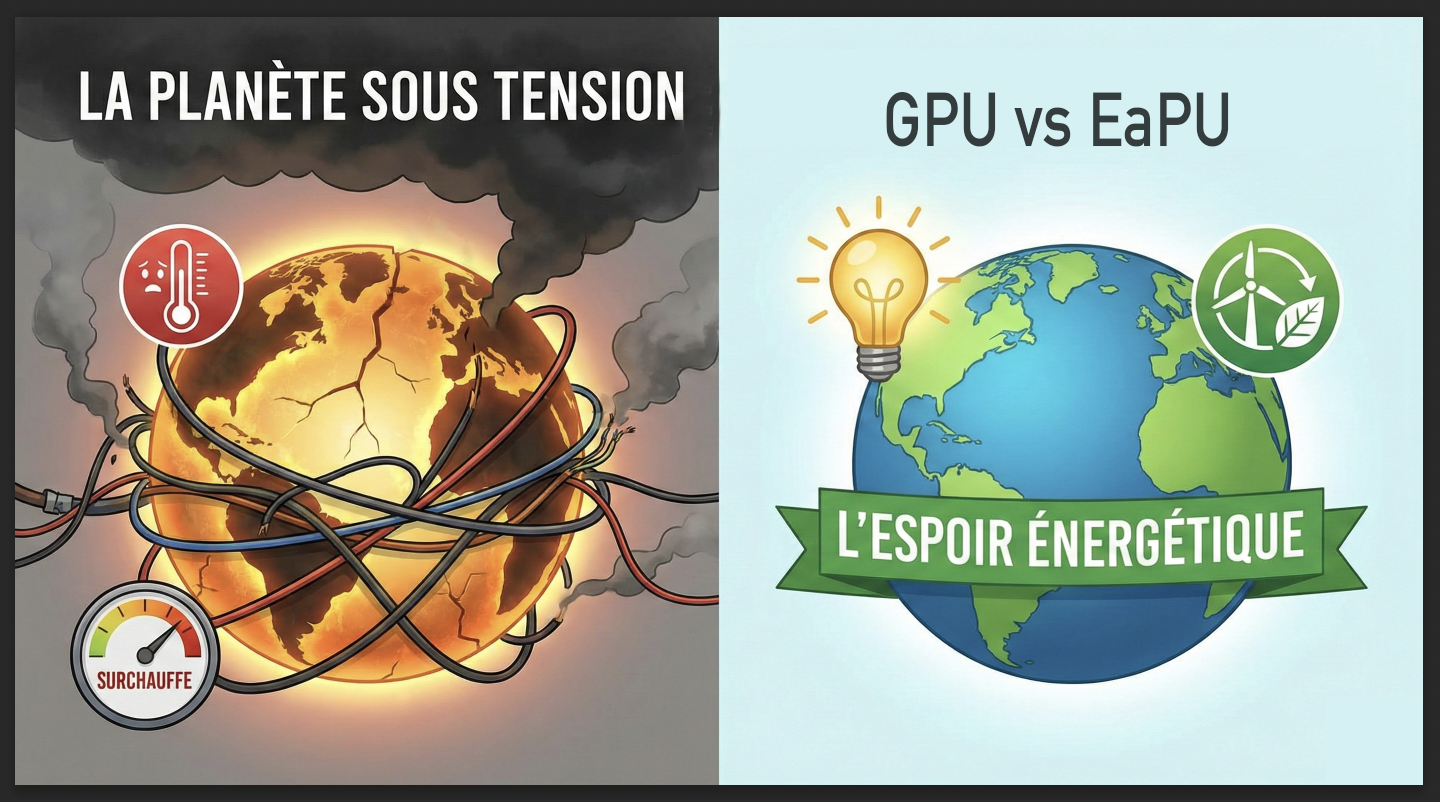

Ensuite, la responsabilité Environnementale. L'IA est énergivore. Entraîner des modèles et, surtout, les interroger en permanence a un coût carbone et électrique non négligeable. Mon socle, via la matrice de criticité, encourage la "sobriété numérique" ou en tout cas une mise à disposition responsable des modèles. Si un cas d'usage est simple (Quadrant A), nous devons privilégier des "Petits Modèles de Langage" (SLM) beaucoup moins énergivores. Ne pas utiliser un marteau-piqueur pour planter un clou est une question de bon sens économique, mais aussi un impératif écologique. Un enjeu de monitoring et d'audit est peut-être nécessaire pour garantir une utilisation responsable.

Conclusion : vers l'entreprise agentique

Ce socle que je vous ai présenté au fil de ces 4 articles a une ambition : réconcilier l'innovation débridée et la rigueur nécessaire.

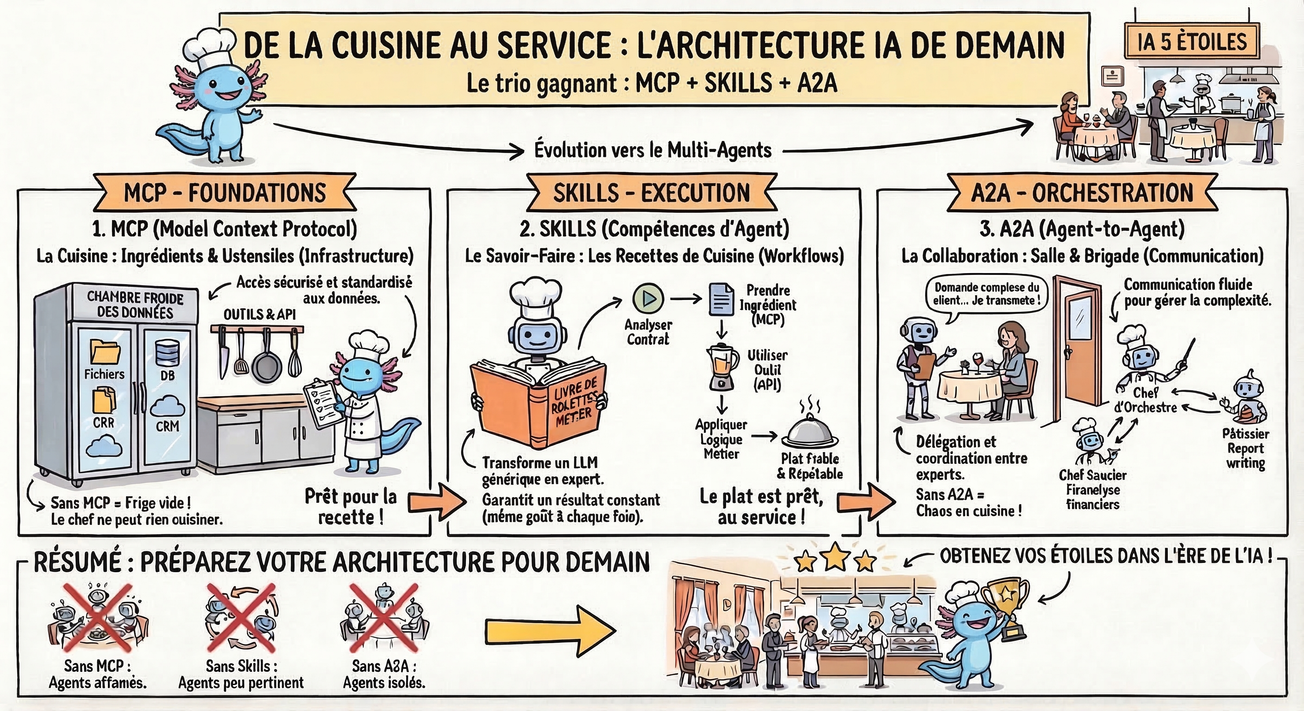

L'objectif final n'est pas d'avoir une entreprise "augmentée" où l'on a juste greffé des chatbots sur des vieux processus. L'objectif est de bâtir une entreprise intelligente, prête pour l'ère de l'IA Agentique.

Dans ce futur proche, des agents autonomes exécuteront des tâches complexes sous la supervision d'humains devenus architectes et stratèges. C'est pour préparer cette collaboration homme-machine de haut niveau que nous devons, dès aujourd'hui, poser des fondations de gouvernance saines.

C'est un chantier technique, organisationnel, mais avant tout culturel. Et il commence maintenant.

Précédemment