En ce moment, l’air est saturé. Le bruit de fond médiatique devient assourdissant. On nous parle de « rééducation politique », on attaque les messagers. Mais en tant que journaliste, ce qui m'inquiète le plus, ce n'est pas la critique. C'est la disparition progressive des faits au profit de l'opinion, dictée par une logique purement mercantile.

C’est là que le biais entre en jeu.

Nous avons tous des biais humains. C’est pour cela que notre métier existe : pour appliquer une méthode, une déontologie, une recherche de la nuance qui dépasse nos propres opinions. Mais aujourd'hui, certains plateaux ont abandonné cette rigueur pour devenir des chambres d'écho industrielles.

Et si la technologie, souvent décriée, nous aidait à y voir plus clair ?

J'ai découvert l'initiative incroyable de Quota Climat, Science Feedback et Data For Good grâce à Noémie Coget sur la scène du Tech Rocks Summit 2025. Une initiative brillante pour détecter la désinformation climatique à grande échelle. Car si l'humain est faillible, la donnée, elle, peut objectiver ce ressenti.

Emmanuel Vincent - Director at Science Feedback et Eva Morel - Secrétaire générale de QuotaClimat

Le constat : l'industrialisation du mensonge

Pendant longtemps, la surveillance des médias reposait sur des communautés de bénévoles écoutant radio et télé pour repérer les manquements à la déontologie. Une tâche noble, mais chronophage et impossible à passer à l'échelle.

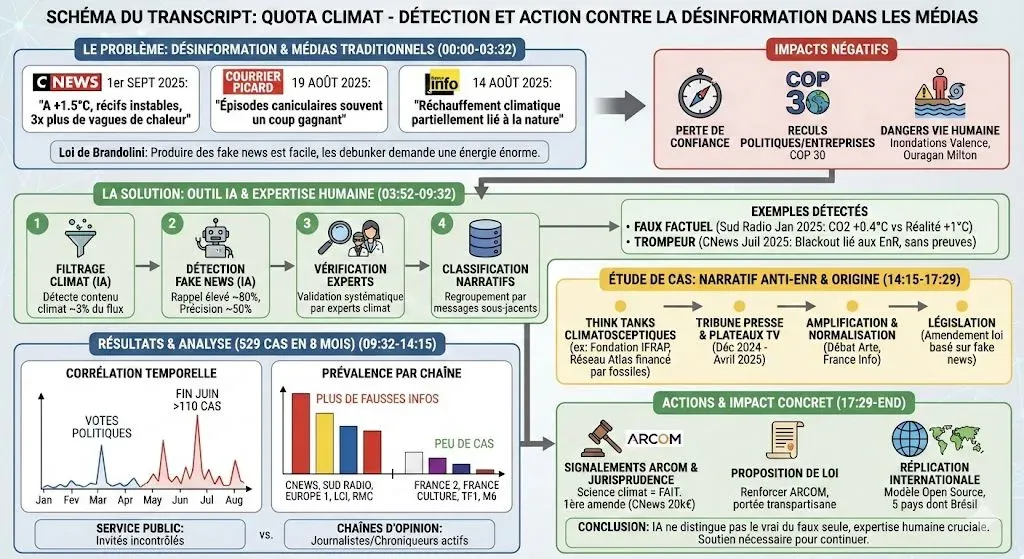

Pour dépasser ce stade artisanal, ces associations ont développé un outil d'intelligence artificielle capable d'analyser les flux médiatiques en continu. Les résultats de leur rapport, basé sur l'analyse de 8 mois de contenu sur les 18 chaînes les plus suivies en France, sont implacables:

- 529 cas de désinformation avérés ont été détectés, soit une quinzaine par semaine.

- 70% de ces fausses informations ciblent spécifiquement les énergies renouvelables , suivies par les voitures électriques et les politiques climatiques.

- Les vecteurs sont identifiés : chroniqueurs, invités, mais aussi parfois journalistes, notamment sur des antennes comme CNews ou Sud Radio.

L'analyse temporelle révèle que ces pics de désinformation ne sont pas aléatoires : ils sont corrélés à l'agenda politique, comme lors des débats sur la programmation pluriannuelle de l'énergie en juin 2025.

Le défi tech : biais humain vs biais d'entraînement

Pour une audience technique comme celle de SFEIR, le cœur du sujet réside dans la construction de cet outil. Comment s'assurer que l'IA ne reproduit pas elle-même des biais ?

Emmanuel Vincent, fondateur de Science Feedback, soulève un point crucial : la qualité du Dataset.

L'équipe a dû entraîner ses modèles sur des cas historiques de désinformation, mais aussi spécifiquement sur des données audiovisuelles, car la syntaxe et la rhétorique à l'oral (TV/Radio) diffèrent de celles des réseaux sociaux.

Mais le véritable danger réside dans ce que l'on considère comme la "vérité terrain" :

- Si vous entraînez un modèle sur des faits scientifiques et des rapports du GIEC, vous obtenez un outil de détection fiable.

- Si, comme le modèle Grok sur X, vous l'entraînez sur des blogs climatosceptiques, vous créez une machine à halluciner qui nie l'origine humaine du changement climatique.

C'est pourquoi l'approche "Human-in-the-loop" reste indispensable. Les LLM sont très convaincants, même lorsqu'ils inventent. Chez Science Feedback, chaque cas détecté par l'IA est vérifié par un scientifique pour éviter les faux positifs.

Pourquoi le code a des conséquences réelles

On pourrait se dire que ce n'est que de la télé.

Mais la désinformation médiatique a un effet direct sur les comportements électoraux et législatifs, comme l'a prouvé l'exemple du Brexit où la diffusion d'un journal local unique a inversé les votes d'une bourgade, souligne Eva Morel, Secrétaire générale de QuotaClimat.

Plus grave encore, cette désinformation tue !

"Lors des inondations de Valence, de faux numéros d'urgence ont circulé, et lors de l'ouragan Milton aux États-Unis, des gens ont refusé d'évacuer par peur de pillages basés sur des fake news très réalistes du président Trump, mettant ainsi leur vie en danger", poursuit-elle.

Pour une IA garante de la démocratie

Le journalisme ne peut pas être une guerre de tranchées idéologique. Il doit rester un rempart de faits et de nuances. Mais face à des acteurs privés ou des think tanks (comme l'Heartland Institute aux USA) qui industrialisent le doute, nous avons besoin d'outils puissants.

La vérification des faits ne doit pas être laissée aux mains de ceux qui produisent l'information, ni à des acteurs privés aux agendas opaques. C'est à des régulateurs comme l'ARCOM de se saisir de ces technologies pour exercer un contre-pouvoir indépendant et démocratique.

Chez SFEIR, nous saluons cette initiative qui place l'Open Source au service de l'intérêt général. Déjà exporté au Brésil, en Belgique et en Espagne, ce modèle prouve qu'une technologie rigoureuse — bien codée et correctement entraînée — est une arme redoutable pour préserver la qualité de l'information.