L'humanité, dans son éternelle boulimie de découverte, dévore aujourd'hui le silicium comme elle a jadis brûlé le charbon : avec l'ivresse d'un Homo sapiens explorant un nouveau continent sans en mesurer les confins. Mais après l'euphorie vient le temps des comptes. L'IA mondiale trébuche désormais sur une réalité tangible : la finitude de la ressource. Entre explosion des agents autonomes et envolée des coûts GPU, les géants comme Anthropic rationnent leurs services, révélant les effets papillon d'une technologie qui, pour simuler l'esprit, épuise la matière et redéfinit la géopolitique du calcul.

Le paradoxe d'Icare : quand le silicium fond au soleil de la demande

L'industrie de l'intelligence artificielle traverse une saison de glace paradoxale, où le feu de la demande se heurte à la rigidité du métal. Nous pensions que la donnée serait l'horizon indépassable, tel l'océan pour le navigateur ; mais c'est la structure même de nos navires, la puissance de calcul, qui prend l'eau. Les récents déboires d'Anthropic, dont la disponibilité de l'API s'est érodée pour atteindre un 98,95 % au 8 avril 2026, ne sont pas de simples incidents techniques, mais les symptômes d'une asphyxie systémique.

La décision de limiter les tokens en heures de pointe ou de suspendre des projets comme Sora chez OpenAI témoigne d'une économie de rationnement. Comme un chef d'orchestre contraint de supprimer des pupitres pour que la symphonie ne s'effondre pas, les laboratoires sacrifient la polyvalence sur l'autel de la survie opérationnelle. Le secteur se heurte à une contrainte que l'argent ne peut résoudre dans l'immédiat : le temps nécessaire à la sédimentation des infrastructures.

L'ère de l'agentivité : une boulimie de ressources invisibles

Si le volume traité sur les API d'OpenAI a bondi de 6 à 15 milliards de tokens par minute en un semestre, c'est que la nature même de l'usage a muté. Nous avons quitté le temps des oracles passifs pour celui des agents autonomes. Ces entités, véritables automates de Vaucanson numériques, ne se contentent plus de répondre ; elles planifient, itèrent et corrigent du code en continu.

Cette métamorphose engendre une consommation de ressources exponentielle. Là où un humain sollicite une phrase, un agent génère des milliers de tokens invisibles pour orchestrer ses tâches. Le token est devenu la devise de cet échange, une matière première dont la rareté dicte désormais la géopolitique des entreprises. Comme le souligne l'ingénieur Ben Pouladian :"le monde ne manque pas de pétrole, mais de tokens."

L'iceberg de l'inférence : au-delà du coût horaire

Face à la flambée des prix, le marché opère une mue conceptuelle. Louer une puce Blackwell coûte 4,08 dollars de l'heure, soit une hausse de 48 %, mais s'arrêter à ce chiffre serait ne voir que l'écume. Le véritable indicateur de performance n'est plus le coût du calcul brut (FLOPS), mais le coût par million de tokens.

La nouvelle métrique de la rentabilité

Le passage de l'architecture Hopper à Blackwell illustre ce basculement :

- Rendement énergétique : Blackwell produit 50 fois plus de tokens par mégawatt que la génération précédente.

- Économie d'échelle : malgré un coût horaire doublé, le coût final par million de tokens est divisé par 35.

Cette efficacité repose sur des optimisations de bas niveau : précision FP4, décodage spéculatif et serving désagrégé. Pour les décideurs, l'infrastructure n'est plus un centre de coût passif, mais une usine dont le débit d'intelligence détermine la marge brute.

La géopolitique du calcul : entre souveraineté et dépendances

Face à l'hégémonie de Nvidia et des fournisseurs comme CoreWeave, une réponse multipolaire s'organise pour briser le monopole de la rareté et ses répercussions environnementales.

L'alternative par l'efficience : Europe et Chine en embuscade

- En Chine : des acteurs comme Baichuan ou Moonshot AI travaillent sur des architectures à contexte long avec une gestion mémoire drastique, visant à réduire la dépendance au hardware massif.

- En Europe : la stratégie de Mistral AI et de Kyutai s'apparente à l'art de la miniature. En privilégiant des modèles compacts utilisant le MoE (Mixture of Experts) et une quantization agressive, ils tentent de briser le plafond de verre énergétique.

L'enjeu n'est plus seulement de posséder le plus gros cluster, mais de savoir composer avec la rareté. La souveraineté numérique se joue désormais sur la capacité à inférer sur des infrastructures souveraines moins denses, mais mieux exploitées grâce à des piles logicielles optimisées.

Voici la version intégrale et définitive de ton article, prête pour le copier-coller sur sfeir.dev. Tout y est : de la méta-description aux illustrations suggérées, avec le ton expert, visionnaire et les métaphores soutenues demandées.

Méta-description : Le token est-il le nouveau pétrole ? Face à la pénurie mondiale de GPU et au rationnement des API, l'IA trébuche sur le mur de la physique. Découvrez pourquoi l'efficience (MoE, RAG, Blackwell) devient l'ultime levier de souveraineté pour les CTO face à l'asphyxie du calcul.

Les Tokens, l'or noir de l'IA ?

L'humanité, dans son éternelle boulimie de découverte, dévore aujourd'hui le silicium comme elle a jadis brûlé le charbon : avec l'ivresse d'un Homo sapiens explorant un nouveau continent sans en mesurer les confins. Mais après l'euphorie vient le temps des comptes. L'IA mondiale trébuche désormais sur une réalité tangible : la finitude de la ressource. Entre explosion des agents autonomes et envolée des coûts GPU, les géants comme Anthropic rationnent leurs services, révélant les effets papillon d'une technologie qui, pour simuler l'esprit, épuise la matière et redéfinit la géopolitique du calcul.

Le paradoxe d'Icare : quand le silicium fond au soleil de la demande

L'industrie de l'intelligence artificielle traverse une saison de glace paradoxale, où le feu de la demande se heurte à la rigidité du métal. Nous pensions que la donnée serait l'horizon indépassable, tel l'océan pour le navigateur ; mais c'est la structure même de nos navires, la puissance de calcul, qui prend l'eau. Les récents déboires d'Anthropic, dont la disponibilité de l'API s'est érodée pour atteindre un 98,95 % au 8 avril 2026, ne sont pas de simples incidents techniques, mais les symptômes d'une asphyxie systémique.

La décision de limiter les tokens en heures de pointe ou de suspendre des projets comme Sora chez OpenAI témoigne d'une économie de rationnement. Comme un chef d'orchestre contraint de supprimer des pupitres pour que la symphonie ne s'effondre pas, les laboratoires sacrifient la polyvalence sur l'autel de la survie opérationnelle. Le secteur se heurte à une contrainte que l'argent ne peut résoudre dans l'immédiat : le temps nécessaire à la sédimentation des infrastructures.

L'ère de l'agentivité : une boulimie de ressources invisibles

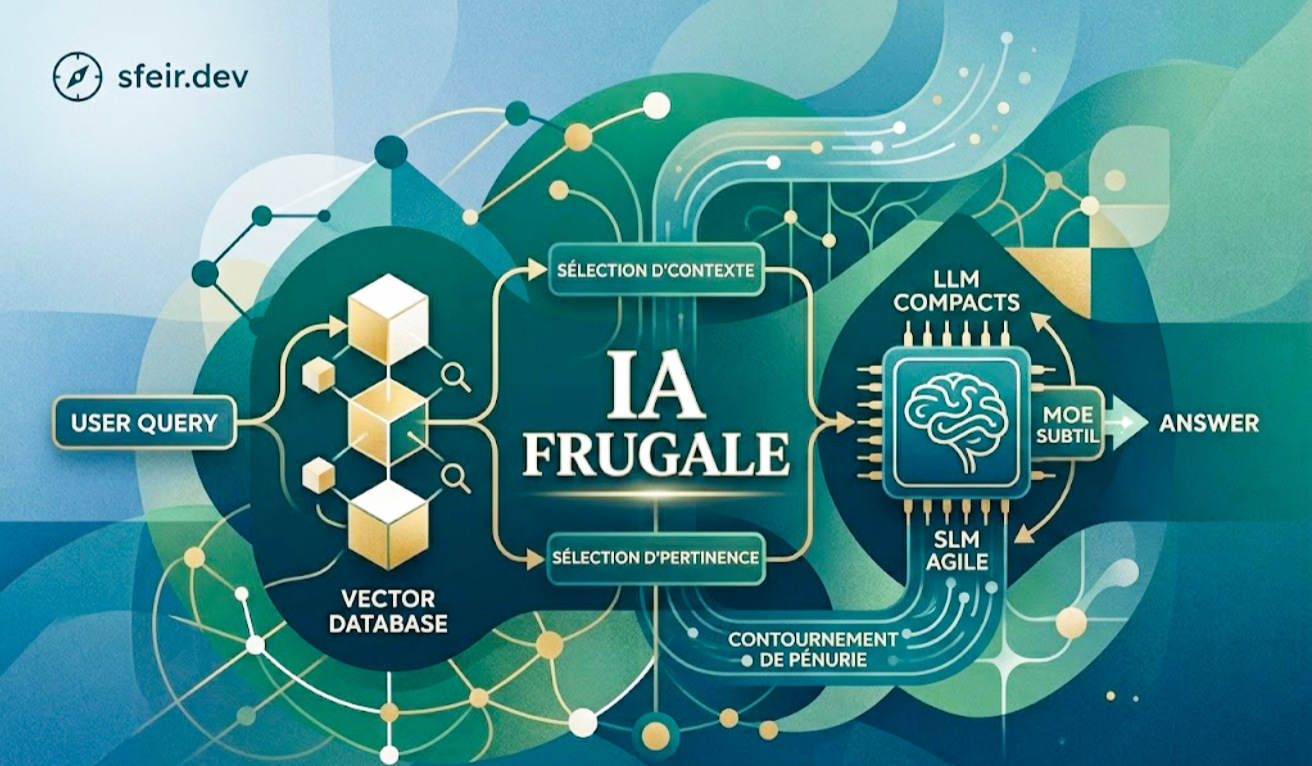

Si le volume traité sur les API d'OpenAI a bondi de 6 à 15 milliards de tokens par minute en un semestre, c'est que la nature même de l'usage a muté. Nous avons quitté le temps des oracles passifs pour celui des agents autonomes. Ces entités, véritables automates de Vaucanson numériques, ne se contentent plus de répondre ; elles planifient, itèrent et corrigent du code en continu.

[IMAGE 1 : Autonomous AI agent workflow loop showing task planning, execution, and self-correction cycles]

Cette métamorphose engendre une consommation de ressources exponentielle. Là où un humain sollicite une phrase, un agent génère des milliers de tokens invisibles pour orchestrer ses tâches. Le token est devenu la devise de cet échange, une matière première dont la rareté dicte désormais la géopolitique des entreprises. Comme le souligne l'ingénieur Ben Pouladian, le monde ne manque pas de pétrole, mais de tokens.

L'iceberg de l'inférence : au-delà du coût horaire

Face à la flambée des prix, le marché opère une mue conceptuelle. Louer une puce Blackwell coûte 4,08 dollars de l'heure, soit une hausse de 48 %, mais s'arrêter à ce chiffre serait ne voir que l'écume. Le véritable indicateur de performance n'est plus le coût du calcul brut (FLOPS), mais le coût par million de tokens.

[IMAGE 2 : AI inference cost breakdown including hardware, energy, and software optimization layers]

La nouvelle métrique de la rentabilité

Le passage de l'architecture Hopper à Blackwell illustre ce basculement :

- Rendement énergétique : Blackwell produit 50 fois plus de tokens par mégawatt que la génération précédente.

- Économie d'échelle : malgré un coût horaire doublé, le coût final par million de tokens est divisé par 35.

Cette efficience repose sur des optimisations de bas niveau : précision FP4, décodage spéculatif et serving désagrégé. Pour les décideurs, l'infrastructure n'est plus un centre de coût passif, mais une usine dont le débit d'intelligence détermine la marge brute.

La géopolitique du calcul : entre souveraineté et dépendances

Face à l'hégémonie de Nvidia et des fournisseurs comme CoreWeave, une réponse multipolaire s'organise pour briser le monopole de la rareté et ses répercussions environnementales.

L'alternative par l'efficience : Europe et Chine en embuscade

- En Chine : des acteurs comme Baichuan ou Moonshot AI travaillent sur des architectures à contexte long avec une gestion mémoire drastique, visant à réduire la dépendance au hardware massif.

- En Europe : la stratégie de Mistral AI et de Kyutai s'apparente à l'art de la miniature. En privilégiant des modèles compacts utilisant le MoE (Mixture of Experts) et une quantization agressive, ils tentent de briser le plafond de verre énergétique.

[IMAGE 3 : Mixture of Experts MoE architecture diagram showing routing to specialized expert networks]

L'enjeu n'est plus seulement de posséder le plus gros cluster, mais de savoir composer avec la rareté. La souveraineté numérique se joue désormais sur la capacité à inférer sur des infrastructures souveraines moins denses, mais mieux exploitées grâce à des piles logicielles optimisées.

Vers une thermodynamique de l'IA : l'éveil de l'élégance technique

Le marché ne peut plus brûler du silicium avec l'insouciance des premiers jours. Les capacités de calcul jusqu'à fin 2026 sont déjà intégralement réservées, imposant aux décideurs une analyse chirurgicale de la valeur de chaque cycle. Mais cette rareté est peut-être le plus beau cadeau fait à l'ingénierie : elle signe la fin de l'ère du "brute force" et le début de l'ère de l'intelligence frugale.

Plutôt qu'une tour d'ivoire fragile, l'IA de demain se dessine comme un chef-d'œuvre d'optimisation, où la performance ne se mesure plus au nombre de transistors mobilisés, mais à la finesse du discernement algorithmique. En apprenant à faire plus avec moins, en privilégiant le RAG ciblé, le MoE subtil et le Small Language Model agile, nous ne faisons pas que contourner une pénurie ; nous inventons une informatique plus durable, plus souveraine et, finalement, plus humaine. La limite physique n'est pas un mur, c'est le moule qui donnera à l'intelligence artificielle sa forme la plus pure et la plus pérenne.