Échange imaginaire avec RAISE, la plateforme IA Générative multi LLMs de SFEIR

⚠️ Disclaimer : Aucune IA n’a été maltraitée ou contrainte dans l’interview qui suit. Et pour cause : aucune IA n’a été utilisée ! Afin de limiter l’empreinte carbone de cet article, les réponses de RAISE ont été purement imaginées par l’auteur. Il ne s’agit donc pas d’une véritable interview. Comme toujours, le fond de l’article est rigoureusement documenté.

Thibaut Rety : Bonjour RAISE, et merci de consacrer quelques octets à cet échange. Pour ceux qui ne vous connaissent pas encore, pourriez vous vous présenter en quelques mots ?

RAISE : Bien sûr. SFEIR et WEnvision m'ont mis au monde. Ma naissance a été une grande fierté pour mes parents. Concrètement, je suis une plateforme cloud native entièrement serverless ! Je suis compatible avec tous les modèles de langage LLM disponibles (gratuits ou payants). De plus, avec moi, vos prompts sont sécurisés !

L'empreinte carbone d'une requête 🌱

Thibaut Rety : Quel talent ! RAISE, nous allons considérer que tu es expert en écologie numérique. Peux-tu comparer l’empreinte carbone d’une requête LLM avec celle d’une recherche classique, par exemple sur Google ?

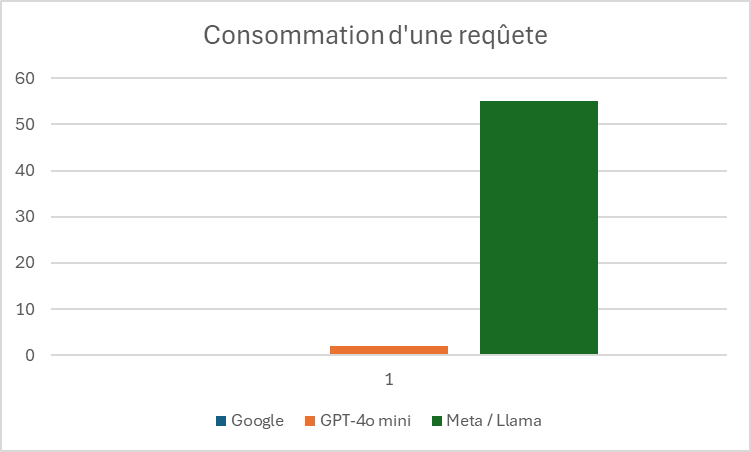

RAISE : Cela dépend du LLM utilisé. Certains sont moins gourmands que d'autres. Voici quelques chiffres pour se faire une idée :

- Une requête sur Google (sans IA générative) équivaut à 0,3 grammes de CO2 rejeté

- Une requête sur GPT-4o mini (35 milliards de paramètres) équivaut à 2 grammes de CO2 rejeté

- Une requête sur Meta / Llama équivaut à 55 grammes de CO2 rejeté

Thibaut Rety : Intéressant ! Suggères tu de ne plus utiliser l'IA afin de ne pas détruire d'avantage notre planète ?

RAISE : Question piège ! Ce n'est absolument pas mon propos. Si l'IA générative s'est développée aussi vite ces dernières années, qu'elle a été adoptée par énormément de personnes (particuliers comme professionnels) et qu'elle a changé nos habitudes numériques, c'est avant tout parce qu'elle répond à un besoin. L'IA n'est ni bonne, ni mauvaise en soi. C'est un simple outil.

Thibaut Rety : Mais qu'importe son utilisation, cet outil pollue !

RAISE : Certaines entreprises (comme Engie par exemple) utilisent l'IA au service des énergies nouvelles. L'IA (pas forcément générative) leur permet de proposer des solutions qui optimisent l'utilisation des énergies propres à grande échelle et limitent ainsi l'utilisation des énergies polluantes.

Thibaut Rety : Je comprends, mais si on reste sur les IA génératives, elles polluent énormément !

RAISE : En effet, si on s'en sert n'importe comment. Souhaitez vous que je vous donne quelques conseils sur l'utilisation des IA génératives afin de limiter l'impact carbone engendré ?

Thibaut Rety : Oui s'il te plaît.

RAISE : C'est parti :

Comment optimiser l'utilisation de l'IA générative ? ⚙️

Un prompt bien rédigé vaut mieux qu’un long dialogue📜

On a vu que ce qui est coûteux est la requête. Chaque ligne de dialogue avec une IA générative est une nouvelle requête. De ce fait, il vaut mieux une requête longue, complète et précise pour ne pas engendrer un dialogue.

N'utiliser l'IA que lorsque c'est nécessaire 🛑

Avant d’utiliser une IA générative, demandez-vous si une recherche classique ne serait pas plus sobre… et plus rapide ! Si c'est le cas, il faut se demander si cette valeur ajoutée est assez forte pour justifier l'utilisation de l'IA.

Exemple : Le besoin est de connaitre la hauteur du Mont Blanc. Une simple recherche Google permet d'avoir la réponse. L'IA n'a pas de valeur ajoutée, il faut donc éviter de l'utiliser dans ce cas-là.

Choisir le modèle approprié 🏆

Plus le modèle est spécifique, plus il est précis et léger. Il faut donc préférer un modèle spécifique et entraîné pour un besoin en particulier, au détriment d'un modèle générique qui prétend tout connaître.

Pour faire une analogie : Si vous avez besoin d'une recette de tarte au citron, vous irez chercher dans un livre de recettes de tartes, plutôt que dans un livre de recettes génériques.

Ne pas laisser de traces… 👣

Si l'outil d'IA utilisé conserve un historique, alors ce dernier doit être stocké. Cela est également source de pollution. Supprimez régulièrement les historiques inutiles pour limiter le stockage inutile.

Cela rejoint l'idée du long prompt. La contextualisation permet de rendre plus spécifique l'IA générative. Concrètement, contextualiser signifie donner à l’IA toutes les informations nécessaires dès la première requête : objectifs, contraintes, public cible, ton, données métier, etc. Cela évite les aller-retours et donc les requêtes supplémentaires.

👉 Et pour aller plus loin : utilisez la technique du RAG (Retrieval-Augmented Generation). Cette approche consiste à fournir dynamiquement à l’IA des documents pertinents (issus d'une base documentaire ou d'un moteur de recherche interne) pour enrichir le contexte avant la génération. Cela permet :

- d’éviter les hallucinations,

- de rendre les réponses plus fiables,

- de limiter les échanges superflus avec l’IA.

Quelques sources ? 📚

Thibaut Rety : Merci pour toutes ces réponses ! Aujourd'hui, de plus en plus d'IA génératives citent les sources afin de vérifier l'information générée. Peux-tu me donner les tiennes ?

RAISE : Bien sûr ! Voici les sources utilisées :

https://sfeir.com/fr/nos-offres-innovation-conseil-et-formation/produit-ia-generative/

https://drane-versailles.region-academique-idf.fr/spip.php?article1167

https://bienvivreledigital.orange.fr/societe/environnement/prompter-sans-polluer-mode-demploi.html